Pour le directeur adjoint du Groupe de recherche et d’information sur la paix et la sécurité (Grip), Stan Brabant il est nécessaire d’adopter un traité d’interdiction. Pour le spécialiste des questions de défense Joseph Henrotin, l’arme complètement autonome relève du fantasme.

Stan Brabant: « La perte du contrôle humain sur les armes doit être proscrite »

Directeur adjoint du Groupe de recherche et d’information sur la paix et la sécurité (Grip), Stan Brabant appelle à l’adoption d’un traité d’interdiction parce qu’une arme autonome ne peut pas respecter le droit international humanitaire ni être traduite en justice. Stan Brabant est l’auteur d’un éclairage du Grip du 22 décembre 2020 intitulé « Robots-tueurs: à quand l’interdiction? »

Qu’entendez-vous par « robot tueur »?

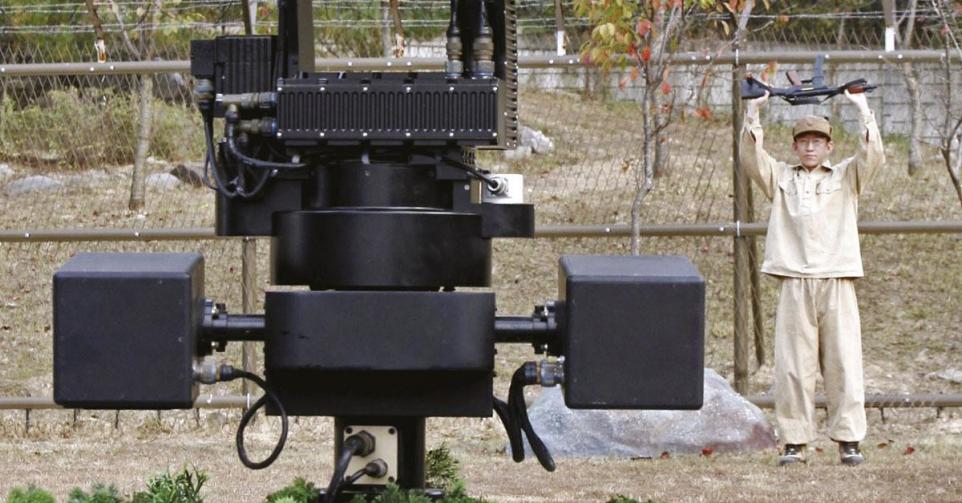

Le « robot tueur » recouvre ce que l’on définit en termes plus techniques par les armes entièrement autonomes, qui ont la capacité de sélectionner et d’attaquer elles-mêmes des cibles. Ces armes n’existent pas encore. Mais certaines commencent à ressembler à des « robots tueurs ». Celle qui en est le plus proche est le navire autonome chinois Jari. Dans cet exemple, subsiste encore un certain contrôle humain. Mais il s’érode petit à petit. Et on est de plus en plus proche de véritables « robots tueurs ».

Pourquoi est-il important, selon vous, d’interdire ce type d’armes?

Une première raison est la perte du contrôle humain parce que dans cette hypothèse, il est impossible de garantir le respect du droit international humanitaire et, en particulier, les deux grands principes de distinction et de proportionnalité. Ces obligations centrales dans le droit international humanitaire ne peuvent pas être transférées à la machine. Elle n’a pas la capacité de faire la balance entre l’intérêt militaire et les impacts humanitaires de son utilisation qui demande une capacité d’analyse et d’empathie. C’est d’ailleurs un élément que le rapporteur des Nations unies sur les exécutions extrajudiciaires soulignait: les dernières barrières psychologiques à l’utilisation de la force tombent à partir du moment où c’est une machine qui décide d’engager un conflit. Une deuxième raison est que le « robot tueur » ne peut pas être traduit en justice et frappe donc en toute impunité. Enfin, ces armes seront relativement peu chères – le missile rôdeur miniature américain Switchblade coûte de l’ordre de 70 000 dollars – et pourraient aisément tomber dans les mains de groupes terroristes ou être piratées.

Quand une grande majorité d’états est favorable à l’établissement d’une nouvelle norme, il y a moyen d’avancer.

Quelle est la position des grandes puissances militaires sur cette question?

Prenons les cinq membres permanents du Conseil de sécurité de l’ONU. Les Etats-Unis ont soulevé des questions juridiques, politiques et éthiques sur cette question dans le cadre du Conseil des droits de l’homme des Nations unies. Ils autorisent cependant les armes autonomes, mais pas totalement autonomes, et disent ne vouloir ni les encourager ni les interdire. On observe cependant qu’ils investissent dans leur développement. Et le contrôle humain sur ces nouvelles technologies a tendance à se réduire, apparaissant sur des aspects généraux d’opération et de moins en moins sur les armes proprement dites.

Politiquement, les Etats-Unis ont jugé, sous l’administration Trump, qu’un traité d’interdiction était prématuré et que le droit international humanitaire était suffisant pour régler cette question. La Chine a appelé en avril 2018 à une interdiction de l’utilisation des « robots tueurs » et a affirmé qu’ils pourraient bouleverser l’équilibre international sur le plan stratégique. Elle a cependant une attitude ambivalente puisqu’elle développe, elle aussi, des armes autonomes. La Russie est plus problématique. Elle est opposée à un traité et n’a pas participé aux dernières discussions sur les armes autonomes à Genève il y a quelques mois. Elle considère la recherche et le développement dans le domaine de l’in- telligence artificielle et de la robotique comme une priorité de sa défense. C’est sans doute l’Etat le plus opposé à une avancée. La France reste très attachée au contrôle humain sur l’usage de la force et a proposé dernièrement une déclaration politique, certes non contraignante juridiquement, sur les armes autonomes, avec l’Allemagne. Parmi les cinq, c’est le Royaume-Uni qui a peut-être l’approche la plus intéressante. Il plaide pour qu’il y ait toujours un contrôle et une autorité humains avant l’usage d’armements et que la responsabilité incombe au commandement et aux opérateurs.

A lire sur le sujet: Politique de la défense: les fausses notes de la partition

Une alliance entre les Etats qui proscriraient ces armes, la société civile et l’opinion publique peut-elle aboutir à une interdiction mondiale?

J’ai l’impression que oui. Si on analyse les précédents du traité d’interdiction des mines antipersonnel de 1997 et de la convention sur l’interdiction des armes à sous-munitions de 2008, on s’aperçoit qu’ils ont créé un stigmate tel que même des Etats qui ne les ont pas rejoints les respectent, à l’exception de la Russie dans le cas du second. Cela montre que quand une grande majorité d’Etats, comme c’est le cas aujourd’hui à propos des armes autonomes, est favorable à l’établissement d’une nouvelle norme, il y a moyen d’avancer. Je suis plutôt optimiste, d’autant plus qu’il n’y a pas vraiment d’Etat qui plaide pour des armes autonomes. La notion de contrôle humain est relativement acceptée même par les Etats cités plus haut, à l’exception de la Russie et, dans une moindre mesure, des Etats-Unis. A ce titre, l’Otan est une enceinte intéressante parce qu’elle peut parfois servir à établir certaines normes en matière de contrôle des armements.

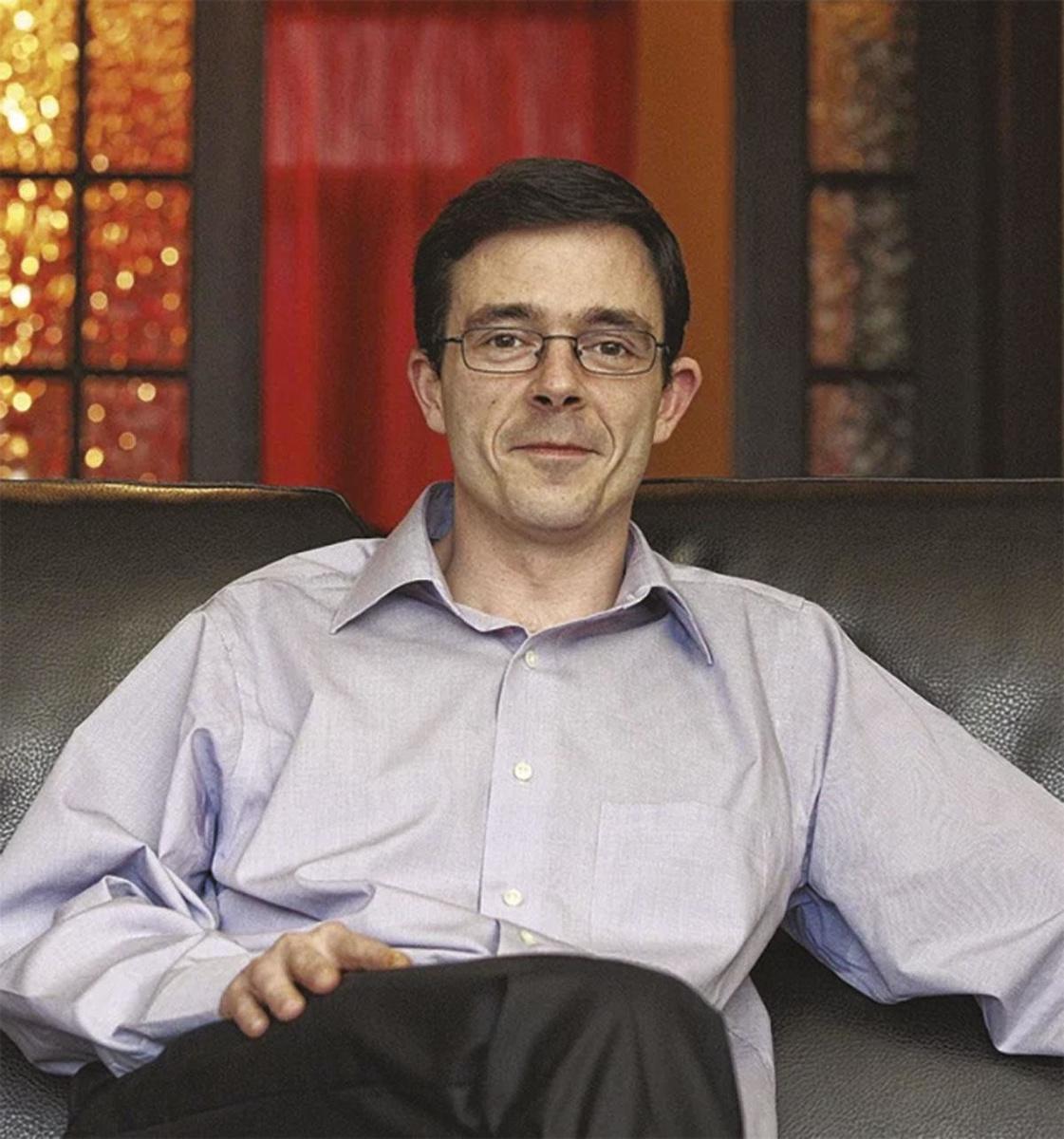

Joseph Henrotin: le « robot tueur » n’est une réalité ni existante ni en cours de conception »

Pour le spécialiste des questions de défense Joseph Henrotin, l’arme complètement autonome relève du fantasme. Quelle que soit la technologie utilisée, il faut surtout promouvoir les principes du droit des conflits et du droit international humanitaire et les traduire dans des règles d’engagement claires.

Le « robot tueur », au stade d’embryon actuellement, deviendra-t-il un jour réalité?

Non. Quand vous tracez la généalogie du terme « robot tueur », vous vous apercevez qu’elle est d’ordre militant. Il a été utilisé dans le cadre de campagnes, par ailleurs tout à fait légitimes, de désarmement. Derrière ces mots, on trouve des choses extrêmement diverses qui sont systématiquement sous contrôle humain. A contrario, d’autres appareillages qui ne répondent pas à la définition du « robot tueur » intègrent des degrés d’autonomisation beaucoup plus poussés, comme dans l’aéronautique civile où la plupart des vols se font aujourd’hui en pilotage automatique. Les systèmes sont toujours conçus pour un objectif par l’être humain, avec une définition de mission.

Il n’existe pas aujourd’hui de système même relativement autonome. Mais s’il n’y a pas d’autonomie, il peut malgré tout exister des automatismes, me direz-vous. Cette description est effectivement beaucoup plus correcte. Un certain nombre de systèmes, par l’intégration de l’intelligence artificielle, vont en effet pouvoir aider le militaire, notamment au ciblage. La guerre est par définition chaotique. Elle s’opère dans l’incertitude la plus totale. Pourquoi fait-on de la stratégie militaire et dispose-t-on de forces armées? Pour ordonnancer le chaos du champ de bataille. C’est la rationalité première d’une force armée. Or, si vous introduisez des systèmes qui sont autonomes, qui vont définir leur propre norme par rapport à l’action militaire, vous ajoutez du chaos au chaos. Ce serait complètement contre-productif. Je ne connais pas aujourd’hui de systèmes qui répondent au canon du « robot tueur ». Cela ne correspond aujourd’hui ni à une réalité existante ni à un système en cours de conception.

Il faut un système de « compensation » à la réduction des effectifs militaires, c’est la robotique.

Faut-il néanmoins encadrer les nouvelles technologies qui ont une certaine autonomie?

Les encadrer, certainement. Mais l’encadrement sera moins efficace s’il est uniquement juridique que s’il est technique et doctrinal. Quand bien même il y aurait un traité d’interdiction des systèmes robotiques, beaucoup d’Etats ne le signeraient pas: la Chine, la Russie, les Etats-Unis, l’Inde… On s’interdirait soi-même l’utilisation d’un matériel dont les autres vont se servir comme un avantage comparatif. La question centrale à côté de laquelle passent les tenants de l’approche du « robot tueur » est celle des règles d’engagement. Vous n’allez pas tirer des obus avec des sous-munitions n’importe quand, n’importe comment. Vous le faites dans le cadre d’un conflit et dans un certain nombre de cas de figures bien précis. Vous allez définir des kill boxes dans lesquelles il n’y a personne d’autre que les ennemis. La question est: quelles sont les règles d’engagement dans lesquelles je vais pouvoir utiliser mon armement? Ces règles d’engagement doivent répondre, pour les armées européennes aujourd’hui, à un certain nombre de dispositions préexistantes et notamment celles du droit des conflits armés, du droit humanitaire… On ne tire pas sur des civils. C’est un principe applicable à tous les systèmes d’armes.

Peut-on avoir les mêmes garanties de respect de ces règles de la part d’autres puissances, peut-être moins scrupuleuses?

Il n’y pas de déterminisme en politique. Mais on voit très bien à travers les exercices militaires que ces puissances conduisent ou les moyens qu’elles mettent en oeuvre, qu’elles n’hésiteraient pas à passer outre les conventions en matière de droit des conflits armés, surtout en réinterprétant le droit dans le sens qui leur convient. Cela me paraît évident. Au-delà, il est important que nous, nous respections les règles et les normes parce que nous en avons besoin eu égard aux civils, dans les conflits asymétriques du type de ceux en cours au Sahel. Qu’on interdise les « robots tueurs » ou pas, la complexité de ces conflits restera la même. Ce qui nous sauve, c’est le respect des normes du droit des conflits armés, du droit humanitaire international et la définition de règles d’engagement solides, compréhensibles et qui se prêtent le moins possible à interprétation. Quel que soit le système d’armes, il faut revenir aux fondamentaux.

L’intérêt des puissances militaires pour ces armements réside-t-il dans la minimisation des pertes humaines?

L’avantage principal est de recréer une efficience perdue. Depuis la fin de la guerre froide, les armées européennes ont fondu. En 1990, la Belgique disposait de trois corps d’armée, soit six divisions de deux à trois brigades, plus une gendarmerie nationale. Aujourd’hui, elle compte deux brigades. On a troqué la quantité pour la qualité. Or, dans les conflits contre d’autres Etats ou contre des groupes irréguliers, la masse est une qualité en soi. En réalité, la qualité permet de compenser en partie la baisse de quantité. Je me suis rendu au Cameroun récemment, même Boko Haram (NDLR: groupe islamiste nigérian qui sévit principalement dans son pays mais, à l’occasion, dans certains Etats voisins) utilise des drones et des mitrailleuses téléopérées. Eux aussi s’approprient de la qualité et, en plus, ils ont de la quantité. Nos avantages comparatifs sont appelés à se réduire. Donc, il faut un système de « compensation », c’est la robotique.

Une initiative belge?

Le rapport des formateurs Alexander De Croo et Paul Magnette, base du programme du gouvernement belge dirigé par le premier, prévoyait une initiative de la Belgique en vue d’une interdiction des armes entièrement autonomes. Or, notre pays doit assurer cette année la présidence, aux Nations unies à Genève, des discussions, ouvertes en 2014, sur ce type d’armes au sein des réunions des Etats parties à la Convention sur certaines armes classiques (CCW). Le titre complet de celle-ci définit plus explicitement son objet: Convention sur l’interdiction ou la limitation de l’emploi de certaines armes classiques qui peuvent être considérées comme produisant des effets traumatiques excessifs ou comme frappant sans discrimination. Tous les Etats membres de l’ONU n’étant pas parties à cette convention, on peut se demander si un autre cadre ne serait pas plus propice à une nouvelle initiative.